Stereotipi generati artificialmente, il rischio della pornografia della povertà 2.0

La rivoluzione dell’intelligenza artificiale generativa sta trasformando con rapidità inedita il modo in cui produciamo e “consumiamo” contenuti e immagini. In questo cambiamento si nasconde un pericolo crescente per chi fa comunicazione in particolare nel mondo della cooperazione internazionale e dell’aiuto umanitario. Un recente articolo del the Guardian ha documentato una crescente diffusione della cosiddetta “AI-generated poverty porn”, un nuovo volto di un fenomeno ben noto che oggi diventa più sofisticato, più veloce e più ingannevole. L’AI non ha certo inventato la rappresentazione sensazionalistica della povertà; in queste pagine abbiamo affrontato spesso questo dibattito negli ultimi dieci anni, registrando anche significativi miglioramenti nella comunicazione etica delle organizzazioni del settore. Oggi però gli strumenti messi a disposizione della tecnologia rendono più facile e veloce generare immagini “d’effetto” a costo zero e senza complicazioni di consenso.

Cos’è la “AI-generated poverty porn”

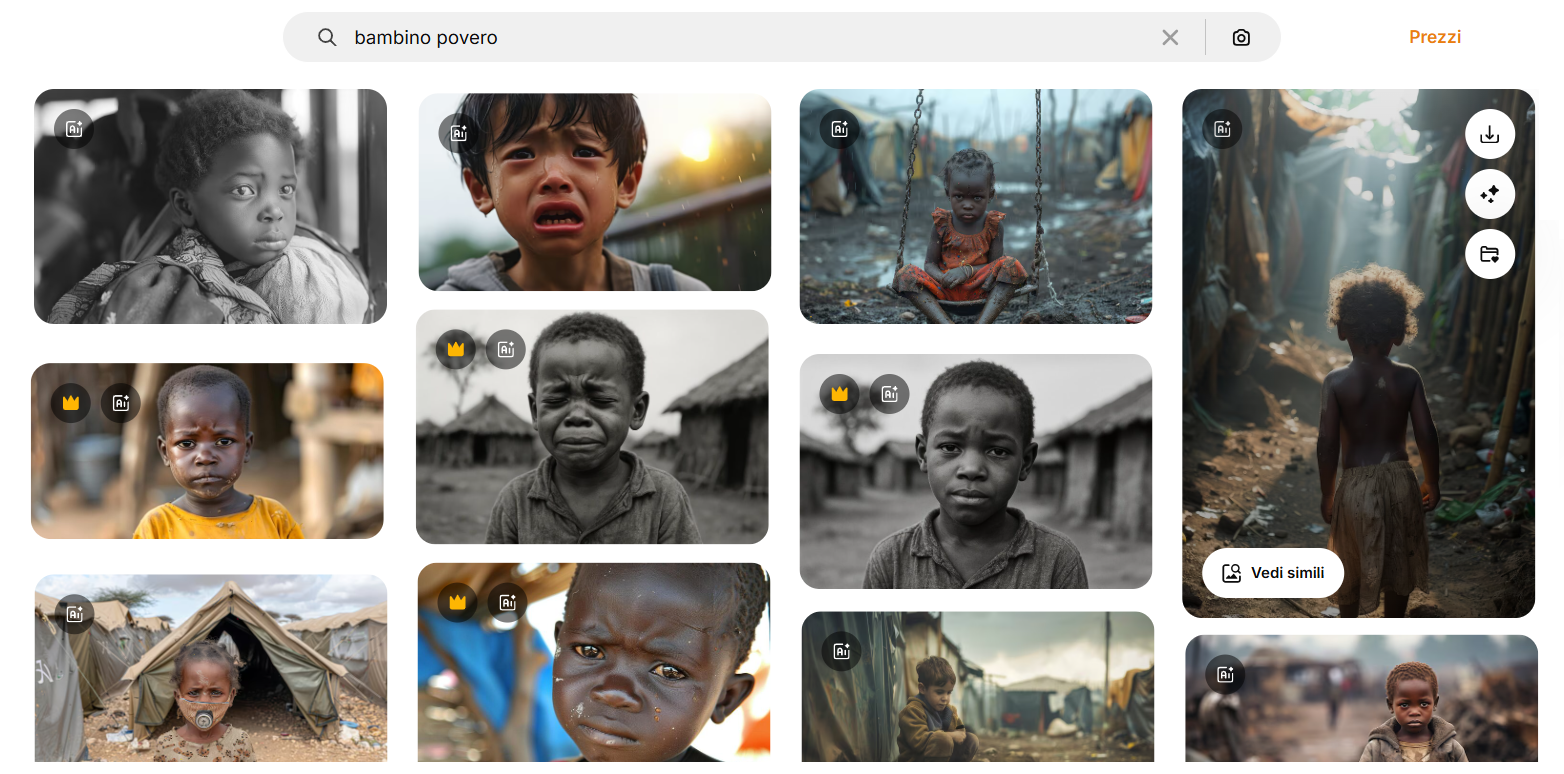

Parliamo di immagini sintetiche generate da modelli di AI che imitano lo stile del fotogiornalismo umanitario per rappresentare persone in condizioni di povertà, crisi o trauma. Le piattaforme che vendono immagini online come Adobe Stock e Freepik proliferano di immagini AI di “bambini affamati”, “campi profughi”, “villaggi africani poveri” che sono spesso vendute con licenza commerciale. Abbiamo provato a fare una ricerca in una di queste piattaforme con la parola chiave “bambino povero” e chiedendo solo immagini generate con AI, questo è il risultato.  Queste immagini, secondo the Guardian, vengono già utilizzate comunemente da diverse ONG e Organizzazioni Internazionali per le loro campagne di sensibilizzazione e raccolta fondi. Il problema non è solo etico o estetico. È strutturale. Queste immagini sembrano reali, e proprio per questo sono ingannevoli, rafforzano narrazioni coloniali e stereotipi su Africa, Asia e Sud globale e cancellano la complessità delle comunità, riducendole a cliché visivi. Anche se la persona non esiste, il pregiudizio rappresentato è reale – e reale è il suo impatto sul pubblico.

Queste immagini, secondo the Guardian, vengono già utilizzate comunemente da diverse ONG e Organizzazioni Internazionali per le loro campagne di sensibilizzazione e raccolta fondi. Il problema non è solo etico o estetico. È strutturale. Queste immagini sembrano reali, e proprio per questo sono ingannevoli, rafforzano narrazioni coloniali e stereotipi su Africa, Asia e Sud globale e cancellano la complessità delle comunità, riducendole a cliché visivi. Anche se la persona non esiste, il pregiudizio rappresentato è reale – e reale è il suo impatto sul pubblico.

Una scappatoia per evitare il consenso

Uno dei motivi per cui alcune organizzazioni stanno sperimentando l’uso di immagini generate artificialmente è la percezione che l’AI possa “risolvere” il problema del consenso: se la persona non esiste, non serve chiedere l’autorizzazione e non ci sono rischi di violazione della privacy. Bisogna considerare però che molti modelli generativi utilizzano dataset che includono fotografie di persone reali mai informate del loro utilizzo, immagini raccolte da contesti vulnerabili o scatti trovati online senza consenso né controllo. Il risultato è quindi che il volto sintetico potrebbe essere la combinazione di caratteristiche apprese da persone reali, spesso appartenenti a gruppi già marginalizzati.

Il paradosso è evidente: non stiamo proteggendo la privacy, stiamo sfruttando un’intera categoria sociale come materiale di addestramento. L’AI rischia di costruire un mondo visivo in cui le persone ritratte non hanno più diritto di parola, perché non esistono — e proprio per questo possono essere rappresentate nella forma più funzionale agli obiettivi di raccolta fondi.

Perché le ONG devono preoccuparsene

Il mandato umanitario si fonda sul principio del “do no harm”. Questo principio non vale solo per gli interventi sul campo, ma anche per la comunicazione, la raccolta fondi, la narrazione pubblica. Utilizzare immagini generate dall’AI che rappresentano persone in condizioni di sofferenza significa:

- strumentalizzare la vulnerabilità per fini comunicativi;

- creare versioni potenziate e artificiali di stereotipi che il settore ha combattuto per anni;

- esporre l’organizzazione a critiche di manipolazione e perdita di credibilità;

L’utilizzo della AI realistica per ragioni di costo, rapidità o per evitare la complessità del consenso informato può essere una scorciatoia, ma rischia di trasformarsi in un boomerang che alimenta la distorsione della realtà, rafforza gli stereotipi, e può far perdere la fiducia da parte del pubblico.

Una policy interna sull’uso dell’AI generativa

Il tema dell’AI generativa non è solo un rischio: è anche l’occasione per ripensare la rappresentazione delle comunità del Sud globale, superare definitivamente narrative coloniali e costruire una comunicazione più partecipata, più giusta e più umana. Il nostro settore può scegliere se usare la tecnologia per riprodurre i peggiori errori del passato o per costruire nuovi immaginari fondati su dignità e partecipazione. Senza linee guida però, il rischio di uso scorretto da parte di singoli membri del team o fornitori esterni è molto alto. È necessario quindi ragionare sull’opportunità di dotarsi di una policy su questo tema che potrebbe essere elaborata a livello di reti o associazioni di categoria. La linea rossa invalicabile deve sicuramente essere il divieto di sintetizzare immagini di sofferenza umana e povertà. Questo non vuol dire che su altri contesti e necessità non si possa usare l’intelligenza artificiale. Una serie di azioni possono essere prese in considerazione:

- Investire in alternative etiche (ingaggiare fotografi locali, aggiornare asset visivi con nuovo consenso, usare illustrazioni, grafica, mappe quando non è necessario mostrare persone).

- Rafforzare il consenso informato (se l’immagine ritrae una persona reale, usare la buona pratica del consenso eventualmente allargata alla sua comunità di appartenenza)

- Essere trasparenti con il pubblico (dichiarare sempre quando un’immagine è creata con AI)

- Revisione umana obbligatoria per qualsiasi contenuto sensibile e criteri chiari su fornitori, stock e licensing.